El Desafío: Migrar Miles de Consumidores de Datasets

Cualquier equipo de datos conoce el dolor de deprecar un dataset muy usado. Cuando Spotify necesitó desactivar dos de sus datasets de usuarios más críticos para lanzar versiones con nuevas dimensiones, la escala era impresionante: ~1,800 pipelines downstream directos, impactando indirectamente a miles más. El plazo era de seis meses, y los pipelines usaban tres frameworks radicalmente diferentes: BigQuery Runner (SQL), dbt y Scio (Scala). El esfuerzo manual estimado: 10 semanas de ingeniería.

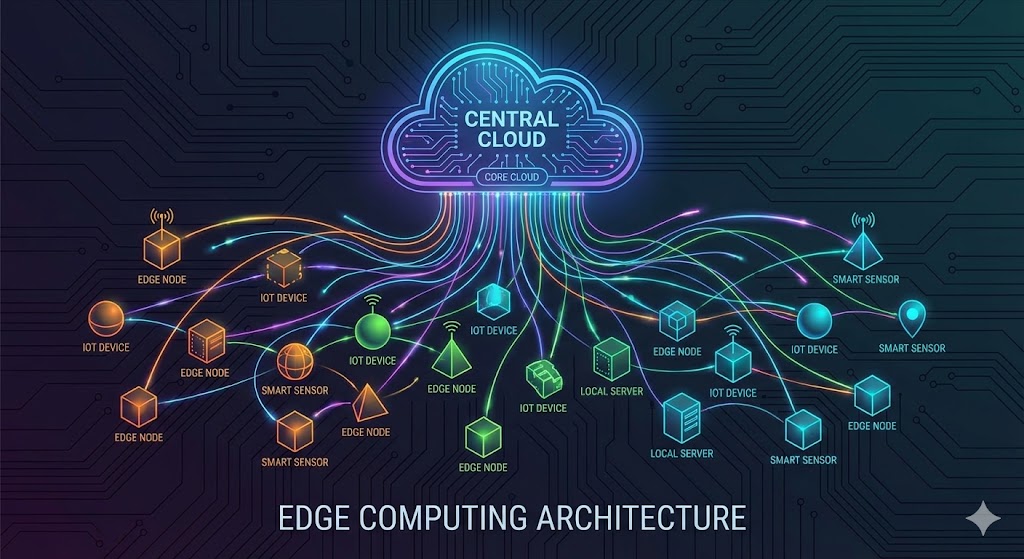

Ahí es donde entró Honk, el agente de codificación autónomo interno de Spotify. Honk no es un wrapper de ChatGPT—es un agente construido específicamente para reescribir código a escala, integrado profundamente con el portal Backstage y la plataforma Fleet Management.

Para una visión estratégica de cómo los agentes de IA pueden generar ROI medible, echa un ojo a nuestra guía sobre maximizando el ROI de IA y gestión de costos.

Cómo Honk Hizo la Migración: Ingeniería de Contexto lo es Todo

Paso 1: Encontrar las Agujas en el Pajar con Backstage

Antes de cualquier cambio de código, el equipo necesitaba entender el linaje completo de los datasets deprecados. Los plugins de linaje de endpoint y Codesearch de Backstage hicieron esto posible. Cada página de endpoint mostraba una lista clara de consumidores downstream, y consultas en Codesearch identificaban los repositorios afectados en todo el ecosistema GitHub de Spotify. Todo se marcó como alcance usando el plugin Fleetshift.

Paso 2: Ingeniería de Contexto—La Fase que Hace o Deshace

Como discutimos en la Parte 2 de la serie Honk, la ingeniería de contexto es la fase más crítica—y más lenta—al trabajar con agentes de codificación autónomos. El gran desafío aquí era la heterogeneidad de los frameworks:

- BigQuery Runner & dbt: Relativamente consistentes entre equipos.

- Scio: Altamente flexible, con implementaciones muy variadas.

En el momento de esta migración, Honk no tenía acceso a habilidades Claude ni configuribilidad personalizada (una decisión de diseño deliberada por seguridad). Esto significaba que el prompt tenía que ser totalmente abarcador—Honk no podía leer esquemas externos o documentación por su cuenta.

El equipo probó dos enfoques:

- Reutilizar guías de migración escritas para humanos: Falló porque el contexto era vago. Honk hizo suposiciones incorrectas sobre mapeos de campos.

- Tablas de mapeo explícitas en el archivo de contexto: Funcionó. Al proporcionar mapeos tabulares claros para cada transformación de campo, Honk entregó rendimiento sólido en la mayoría de los repositorios.

La lección es clara: cuando el agente no puede recopilar su propio contexto, tu archivo de contexto no puede dejar ambigüedad alguna.

# Ejemplo: Fragmento del archivo de contexto para migración BigQuery Runner

TABLA_MApeo = {

"user_id": {

"columna_vieja": "user_id",

"columna_nueva": "user_identifier",

"transformacion": "CAST(user_id AS STRING)"

},

"session_start": {

"columna_vieja": "session_start",

"columna_nueva": "session_start_ts",

"transformacion": "TIMESTAMP_MILLIS(session_start)"

}

}

# Honk usa esta tabla para reescribir instrucciones SELECT

# Si un campo requiere decisión humana, Honk lo deja sin cambios

# y agrega un comentario con enlace a la guía de migración humana

Paso 3: El Vacío de Pruebas

Los pipelines Scio generalmente incluían pruebas unitarias, pero los repositorios BigQuery Runner y dbt raramente tenían. Esto significaba que el principal bucle de retroalimentación de Honk—verificar el trabajo y ajustar—no estaba disponible. El equipo tuvo que depender de los equipos dueños de los pipelines para pruebas manuales antes de fusionar los PRs automatizados.

A pesar de esto, Honk y Fleetshift lanzaron con éxito 240 PRs de migración automatizados. La combinación de la UI de vista general de Backstage con el monitoreo de Fleetshift hizo fácil rastrear el progreso, depurar y comunicar con los equipos.

Para un ejemplo real de arquitectura de plataforma de IA en salud, checa nuestro análisis de la plataforma de diagnósticos con IA escalable de Artera en AWS.

Lecciones Aprendidas y Limitaciones

Lo que Funcionó Bien

- Backstage + Codesearch: Identificó rápidamente todos los repositorios afectados.

- Tablas de mapeo explícitas: Eliminó ambigüedad para el agente.

- UI de Fleetshift: Simplificó el monitoreo y gestión de PRs.

Lo que No Funcionó

- Migraciones Scio: Abandonadas debido a la flexibilidad del framework, haciendo prompts abarcadores imprácticos sin capacidades de auto-contexto del agente.

- Falta de pruebas automatizadas: Honk no pudo verificar su propio trabajo, reduciendo la confianza en los PRs.

Limitaciones Críticas & Advertencias

- Ingeniería de contexto es cara: Escribir un archivo de contexto a prueba de balas tomó más tiempo del esperado. Si tu paisaje de datos no está estandarizado, este costo se multiplica.

- Autonomía del agente es limitada: Sin acceso a herramientas externas (leer esquemas, JIRA tickets), el agente es tan bueno como tu prompt.

- Infraestructura de pruebas es innegociable: Agentes que no pueden ejecutar pruebas no pueden autocorregirse. Invierte en CI/CD y pruebas unitarias antes de escalar el uso de agentes.

- No todos los frameworks son iguales: Frameworks altamente flexibles (como Scio) son más difíciles de automatizar. La estandarización es un prerrequisito para el éxito de los agentes.

Próximos Pasos para Aprendizaje

- Explora Claude Code skills y MCP (Model Context Protocol) para dar a los agentes capacidades de auto-contexto.

- Implementa pruebas unitarias obligatorias en todos los repositorios de pipeline.

- Estudia las próximas características de Honk: recolección de contexto de JIRA y documentación por el propio agente.

- Lee la serie completa de Honk: Parte 1, Parte 2, Parte 3.

Conclusión: El Futuro de los Agentes de Código Autónomos a Escala

El experimento Honk de Spotify prueba que los agentes de codificación autónomos pueden generar ahorros masivos de tiempo—240 PRs automatizados, 10 semanas de ingeniería ahorradas—pero solo cuando la base está correcta. Estandarización de frameworks, pruebas obligatorias e integración profunda con portales como Backstage no son opcionales; son prerrequisitos.

El roadmap es prometedor: versiones futuras de Honk recopilarán su propio contexto de JIRA y documentación, reduciendo la carga de escribir prompts exhaustivos. A medida que los agentes Claude Code mejoran, el techo de lo que los agentes pueden lograr solo va a subir.

Para líderes de ingeniería: Empieza a estandarizar tus pipelines de datos y prácticas de prueba hoy. Los agentes están llegando, y serán tan efectivos como el suelo donde los plantes.