¿Adiós a la Pesadilla de las Pestañas? 🔍

Gestionar infraestructura en la nube siempre ha sido sinónimo de abrir mil pestañas, cruzar registros de logs y perderse en menús. ¿Y si pudieras simplemente preguntarle a tu plataforma qué falla y que además lo arregle? Cloudflare presenta Agent Lee, un asistente de IA integrado directamente en el dashboard que entiende el contexto completo de tu cuenta. Esto no es una feature más, es un cambio de paradigma: de herramientas reactivas a una gestión conversacional y proactiva. Puedes consultar todos los detalles en el anuncio oficial de Cloudflare.

El Truco Está en el Código (Generado) 👨💻

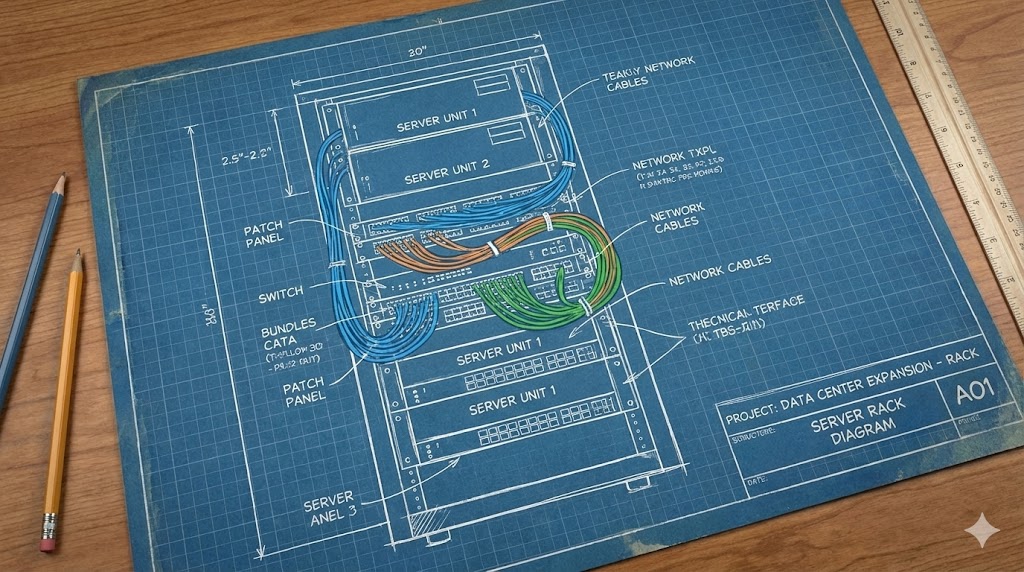

La potencia de Agent Lee viene de su arquitectura única. En lugar de dar definiciones de herramientas simples al LLM, usa un sistema llamado Codemode. Fíjate en el proceso:

- API en TypeScript: Convierte las herramientas de la API de Cloudflare en una interfaz TypeScript.

- LLM como Programador: Le pide al modelo de IA que escriba un script en TypeScript para realizar la tarea que solicitaste. Los LLMs son excepcionales en esto porque están entrenados con código real.

- Ejecución Segura: Ese código generado se envía a un servidor MCP (Model Context Protocol) en sandbox para ejecutarse. Un Durable Object actúa como proxy con credenciales, inspeccionando críticamente cada script.

typescript// Ejemplo del código que Agent Lee podría generar internamente// Tarea: "Muéstrame los 5 mensajes de error principales en mi Worker."import { cloudflare } from './mcp-api'; // API tipada hipotéticaasync function obtenerTopErrores() { const logs = await cloudflare.workers.analytics.logs.query({ filter: 'status_code >= 500', limit: 5, sortBy: 'count', order: 'desc' }); return logs;}// El Durable Object clasificaría esto como operación de LECTURA y la permitiría.// Las API keys se inyectan del lado del servidor, nunca se exponen en el código.

La Barrera de Seguridad: El Durable Object clasifica el código como LECTURA o ESCRITURA. Las lecturas prosiguen. Cualquier operación de escritura—crear un bucket, cambiar una configuración—se bloquea hasta que el usuario la apruebe explícitamente mediante un prompt en la UI. Esta capa de permisos estructural es el núcleo de su seguridad.

Capacidades, Visión y Limitaciones Actuales 🛠️🚧

Agent Lee va mucho más allá de responder preguntas frecuentes. Es un agente multiusos:

| Capacidad | Ejemplo de Prompt | Resultado |

|---|---|---|

| Depuración | "Mi Worker devuelve errores 503." | Analiza logs, sugiere causa (R2, ruta, límite de tasa). |

| Visualización | "Muestra mi tasa de error de las últimas 24h." | Renderiza un gráfico en línea con datos reales de tráfico. |

| Despliegue | "Crea un nuevo bucket R2 para fotos." | Genera y (tras aprobación) ejecuta el código de configuración. |

| Cambios | "Habilita Access para midominio.com." | Aplica el cambio tras tu confirmación. |

La Visión Proactiva: Cloudflare imagina a Agent Lee evolucionando de un asistente reactivo a una interfaz proactiva. El objetivo es que monitorice tus recursos y te alerte de anomalías antes de que sean problemas.

Limitaciones y Consideraciones:

- Estado Beta: Al ser una beta, puedes encontrarte con casos extremos o comportamientos inesperados.

- Contexto Cerrado: Su conocimiento se limita a tu cuenta de Cloudflare.

- Fatiga de Aprobaciones: Despliegues complejos con muchos pasos de escritura pueden ralentizar el flujo con múltiples confirmaciones.

El Panorama General: Hacia Interfaces Nativas en IA

Agent Lee es un paso concreto hacia la interfaz de lenguaje natural para plataformas complejas. Al construirlo con primitivas disponibles públicamente (Workers AI, Durable Objects, MCP), Cloudflare no solo usa sus propias herramientas, sino que proporciona un blueprint para lo que es posible.

Siguientes Pasos para Desarrolladores:

- Prueba la Beta: Si tienes cuenta en Cloudflare, activa Agent Lee y empieza con consultas simples.

- Piensa en Prompts: Cambia el chip de "dónde está el botón" a "cómo describiría esta tarea".

- Explora el Stack: Como Agent Lee se basa en APIs públicas, considera cómo podrías aplicar patrones agentes similares en tus propios proyectos.

Esta tendencia hacia interfaces nativas de IA se está acelerando. Entender los modelos de seguridad (como las capas de permisos de MCP) y los patrones de arquitectura (generación de código vs. llamadas directas a herramientas) que se demuestran aquí es crucial. Para más información sobre tecnologías web en evolución, échale un vistazo a nuestro artículo sobre soluciones de CSS escalable con StyleX y a nuestro análisis sobre funciones de seguridad que preservan la privacidad. ¡A darle! 💻