El Trilema de la Inferencia: Escala, Latencia y Coste

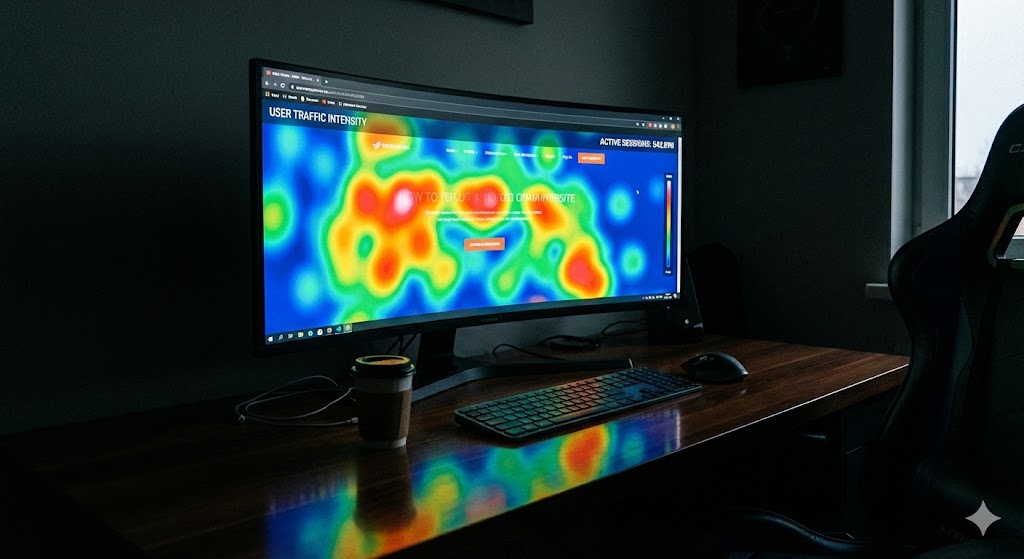

Construir sistemas de recomendación de IA a escala de miles de millones de usuarios presenta un desafío fundamental: el 'trilema de la inferencia'. ¿Cómo aumentas la complejidad del modelo a escala LLM para entender mejor al usuario, manteniendo al mismo tiempo la latencia sub-segundo crítica para la experiencia y unos costes computacionales sostenibles? El escalado por fuerza bruta no funciona, simplemente añadir hardware es inviable.

La respuesta de Meta es el Adaptive Ranking Model, un cambio de paradigma en el serving de IA en tiempo real. En lugar de un modelo único, enruta inteligentemente cada petición de anuncio a la variante de modelo más efectiva y eficiente, basándose en el contexto del usuario en tiempo real. Este avance, detallado en el blog oficial de ingeniería, se sostiene sobre tres innovaciones clave.

![]()

Los Tres Pilares de la Eficiencia a Escala LLM 💡

1. Escalado Eficiente de Modelos: De Lineal a Sub-Lineal

Los modelos tradicionales desperdician computación procesando cada par usuario-anuncio de forma independiente. El Adaptive Ranking Model introduce la Optimización Orientada a la Petición (Request-Oriented Optimization). Calcula las señales densas del usuario (como secuencias largas de comportamiento) una vez por petición y comparte los resultados con todos los candidatos a anuncio. Se logra mediante:

- Difusión en el Kernel (In-Kernel Broadcast): Comparte embeddings a nivel de petición dentro de los propios kernels de la GPU, reduciendo drásticamente la presión en el ancho de banda de memoria.

- Almacén Centralizado de Features: Sustituye copias redundantes de datos por un almacén clave-valor de alta eficiencia, unido a los datos de entrenamiento sobre la marcha.

Esto transforma el coste computacional de lineal (O(n)) a sub-lineal, un requisito para manejar complejidad LLM dentro de un presupuesto de latencia de ~100ms.

2. Co-Diseño Profundo Modelo-Sistema: Maximizando el ROI del Hardware

No puedes soltar un modelo masivo en hardware existente. Este modelo fue co-diseñado con el silicon en el que corre.

- Cuantización Selectiva FP8: En lugar de aplicar baja precisión a lo bruto, un micro-benchmark guía la aplicación de FP8 solo en capas tolerantes a la pérdida de precisión, preservando la calidad y aumentando el throughput.

- Fusión de Kernels Consciente del Hardware: Miles de operaciones pequeñas se fusionan en kernels densos en cómputo (usando técnicas como Grouped GEMM). Esto minimiza los costosos accesos a memoria y alinea el grafo de computación con arquitecturas modernas de GPU, elevando la Utilización de FLOPs del Modelo (MFU) al 35% en hardware heterogéneo.

3. Infraestructura de Serving Reinventada: Rompiendo Límites de Memoria

Cuando los parámetros del modelo se acercan a un billón, exceden la memoria de una sola GPU.

- Escalado de Embeddings en Múltiples GPUs: Las tablas de embeddings se fragmentan (sharded) en un clúster de GPUs con comunicación optimizada, logrando un rendimiento equivalente a configuraciones de una sola GPU.

- Escala de Billones de Parámetros con Asignación Inteligente: El tamaño de los hashes de embedding se asigna dinámicamente según la dispersión de la feature. Los embeddings no usados se podan. Los embeddings unificados permiten que múltiples features compartan una tabla, maximizando la capacidad de aprendizaje con un presupuesto de memoria fijo.

Compromisos, Limitaciones y el Camino por Delante

| Ventaja | Consideración / Desafío |

|---|---|

| Inferencia a escala LLM sub-segundo | Complejidad extrema del sistema; requiere integración vertical profunda, desde el silicon hasta el software. |

| Alta utilización de hardware (35% MFU) | La optimización es muy específica del hardware; portar a nuevas arquitecturas requiere re-ingeniería significativa. |

| Enrutamiento dinámico de peticiones | Introduce sobrecarga de lógica de enrutamiento y potencial de errores, requiriendo sistemas robustos de validación online. |

| Escalado eficiente en coste | La inversión inicial en I+D y co-diseño es enorme, haciendo el enfoque viable principalmente para hyperscalers. |

El Próximo Paso: La hoja de ruta de Meta apunta a mayor autonomía: frameworks agentes para optimización automática de kernels, actualizaciones de modelo casi instantáneas y compresión avanzada. El objetivo es una infraestructura que se adapte autónomamente a las fluctuaciones del tráfico.

Conclusiones y Tus Próximos Pasos

El Adaptive Ranking Model es más una filosofía de ingeniería de sistemas holística que un solo algoritmo. Prueba que la siguiente frontera del rendimiento en IA está en borrar los límites entre el diseño del modelo, el runtime de software y el hardware.

Para Practicantes & Arquitectos:

- Piensa en Sistemas Primero: Antes de buscar complejidad en el modelo, audita tu stack de inferencia en busca de redundancias y cuellos de botella de memoria.

- Adopta la Heterogeneidad: Diseña para ejecución de precisión mixta y diversidad de hardware desde el principio.

- Planea para Escalar Horizontalmente: Cuando los modelos superen un solo dispositivo, una estrategia de sharding no es negociable.

Esta mentalidad es similar a la necesaria para construir sistemas resilientes a gran escala, como los principios que se discuten en esta guía sobre diseño para alta disponibilidad y soberanía en la nube.

Para profundizar, checa la publicación técnica original.

Qué Aprender Después: Para operacionalizar modelos complejos de ML a escala, familiarízate con frameworks de MLOps. Explorar herramientas que aceleran el desarrollo iterativo, como las que se comentan en las tendencias sobre la función Spin de Metaflow, puede ser un gran siguiente paso práctico. ¡Vamos a darle! 🚀