Por Que Escalar Python Além do Seu Notebook?

Você já otimizou seu código Python, usou multiprocessing e talvez até brincou com concurrent.futures. Mas ao enfrentar tarefas realmente intensivas em CPU—como processamento de dados em larga escala, simulações ou cálculos de números primos—uma única máquina atinge seu limite. Distribuir o trabalho entre vários servidores na nuvem é o próximo passo lógico, mas a complexidade do gerenciamento de clusters muitas vezes afasta os desenvolvedores.

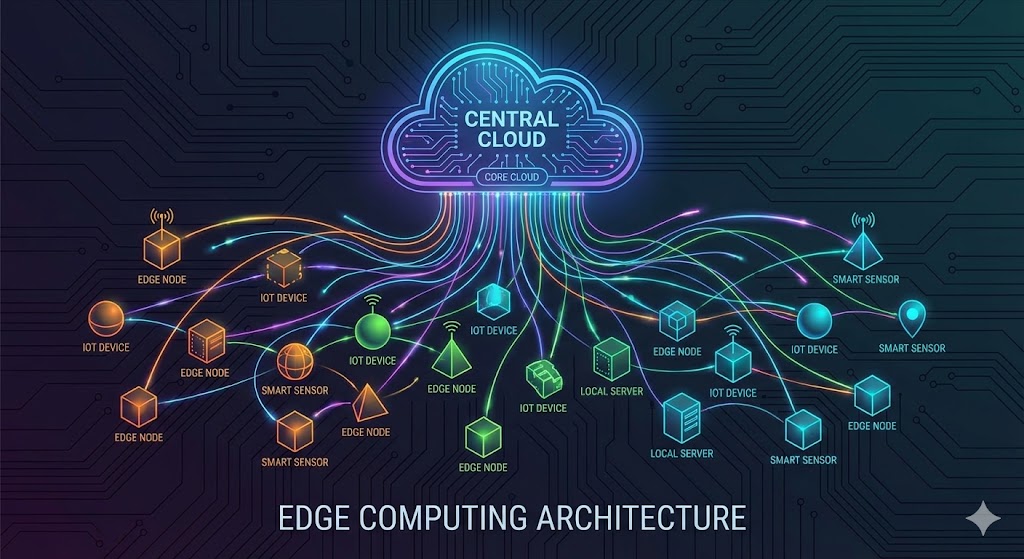

Entra em cena o Ray, um framework de computação distribuída de código aberto. Sua promessa central é simples: escale suas aplicações Python de um notebook para um cluster com mudanças mínimas no código. Neste guia prático, vamos transformar um script local de busca de primos em uma aplicação distribuída rodando em um cluster de 6 nós na AWS EC2, reduzindo o tempo de execução em três vezes. Para conceitos fundamentais, você pode explorar este guia completo sobre os desafios de escalabilidade em Python moderno.

De Script Local para Código Pronto para Cluster

A beleza do Ray está na sua abstração. Vamos ver as modificações principais necessárias. Primeiro, instale o Ray: pip install 'ray[default]'.

Aqui está a função original de contagem de primos, adaptada para o Ray:

import math

import time

import ray

# Inicializa o Ray. Mude esta linha para execução no cluster.

ray.init() # Para execução local

# ray.init(address='auto') # Para execução no cluster

def is_prime(n: int) -> bool:

"""Verifica se um número é primo."""

if n < 2:

return False

if n == 2:

return True

if n % 2 == 0:

return False

r = int(math.isqrt(n)) + 1

for i in range(3, r, 2):

if n % i == 0:

return False

return True

# A mudança chave: decorar a função com @ray.remote

@ray.remote(num_cpus=1)

def count_primes(a: int, b: int) -> int:

"""Conta primos em um intervalo. Esta função será distribuída."""

c = 0

for n in range(a, b):

if is_prime(n):

c += 1

return c

if __name__ == "__main__":

A, B = 10_000_000, 60_000_000 # Intervalo expandido para o cluster

total_cpus = int(ray.cluster_resources().get("CPU", 1))

chunks = max(4, total_cpus * 2) # Cria mais tarefas que CPUs para balanceamento

step = (B - A) // chunks

print(f"Nodes={len(ray.nodes())}, CPUs~{total_cpus}, Chunks={chunks}")

t0 = time.time()

# Distribui as tarefas

refs = []

for i in range(chunks):

start = A + i * step

end = start + step if i < chunks - 1 else B

refs.append(count_primes.remote(start, end)) # .remote() submete a tarefa

# Coleta os resultados

results = ray.get(refs)

total = sum(results)

print(f"Total de primos={total}, Tempo={time.time() - t0:.2f}s")

A transição da execução local para a de cluster se resume a uma linha: mudar ray.init() para ray.init(address='auto'). O runtime do Ray descobre automaticamente o nó principal do cluster.

Configurando e Lançando Seu Cluster Ray na AWS

O Ray usa um arquivo YAML declarativo para definir o cluster. Abaixo está uma configuração para um cluster com um nó principal e 5 nós de trabalho usando Instâncias Spot da AWS EC2 para eficiência de custos.

cluster_name: ray_tutorial_cluster

provider:

type: aws

region: sa-east-1

availability_zone: sa-east-1a

auth:

ssh_user: ec2-user

ssh_private_key: ~/.ssh/sua-chave.pem

max_workers: 10

idle_timeout_minutes: 5 # Economiza custos reduzindo nós ociosos

head_node_type: head_node

available_node_types:

head_node:

node_config:

InstanceType: c7g.8xlarge

ImageId: ami-0abcdef1234567890 # Use uma AMI recente do Amazon Linux 2

KeyName: sua-chave

worker_node:

min_workers: 5

max_workers: 5

node_config:

InstanceType: c7g.8xlarge

ImageId: ami-0abcdef1234567890

KeyName: sua-chave

InstanceMarketOptions:

MarketType: spot # Use Instâncias Spot para os workers

setup_commands:

- pip install -U "ray[default]"

Seções Principais Explicadas:

provider: Define a nuvem (AWS) e região.auth: Credenciais SSH para acesso aos nós.available_node_types: Especifica os tipos de instância. Usar Spot nos workers pode reduzir custos em 60-90%.setup_commands: Prepara cada nó com o Ray.

Comandos para Gerenciar o Cluster:

# Sobe o cluster

ray up cluster.yaml -y

# Submete seu job ao cluster

ray exec cluster.yaml 'python primes_ray.py'

# Monitora pelo dashboard (URL fornecida após 'ray up')

# Derrete o cluster e todos os recursos AWS

ray down cluster.yaml -y

Considerações e Limitações Críticas:

- Custo: Sempre execute

ray down. Use Instâncias Spot e umidle_timeout_minutesbaixo. - Rede: Sua VPC/sub-rede deve permitir comunicação interna. Acesso SSH do seu IP é necessário.

- Estado: Clusters Ray são frequentemente efêmeros. Para armazenamento persistente, monte um volume EFS ou use S3.

- Depuração: Depurar tarefas distribuídas é mais complexo. Use

ray logse o dashboard.

A migração para infraestrutura gerenciada e escalável é uma tendência importante, similar à evolução de projetos como React dentro de fundações maiores, como analisado neste artigo sobre o lançamento da React Foundation sob a Linux Foundation.

Próximos Passos e Conselho Final

Você executou com sucesso uma carga de trabalho Python distribuída na AWS. O salto de performance—de 18 segundos localmente para 5 segundos no cluster—mostra o poder deste paradigma.

Para Onde Ir Agora:

- Explore o Ecossistema Ray: Veja o Ray Train para ML distribuído, Ray Serve para servir modelos e Ray Data para processamento de dados em larga escala.

- Multi-nuvem e Kubernetes: O Ray pode ser implantado no GCP, Azure ou qualquer cluster Kubernetes via operador KubeRay.

- Otimize Localidade de Dados: Para jobs com muitos dados, use

ray.put()para armazenar objetos grandes no objeto store distribuído do cluster.

Dica de Pro: Comece com um protótipo pequeno e funcional na sua máquina local usando ray.init(). Com a lógica correta, mude para address='auto' e escale. Esta abordagem iterativa salva tempo e créditos de nuvem.

Computação distribuída não é mais só para grandes empresas de tech. Frameworks como o Ray democratizam o acesso ao poder de clusters. Comece paralelizando sua função mais custosa, meça o impacto e escale conforme necessário. O objetivo não é só velocidade, mas uso eficiente de recursos. Para mais detalhes sobre a implementação original, confira o guia detalhado no Towards Data Science.